Por Waldemir Cambiucci

Em discussões recentes e enquanto exploro projetos pessoais com agentes e recuperação de respostas baseadas em conteúdo local, atualizado ao longo do tempo, é impossível não notar como uma evolução está acontecendo gradualmente. O uso de RAG está mudando!

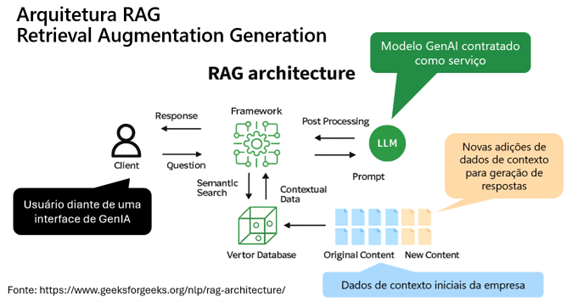

De fato, o RAG deixou de ser apenas um aprimoramento útil para se tornar um dos principais padrões arquiteturais da GenAI corporativa. Para muitas organizações, foi a primeira forma prática de conectar grandes modelos de linguagem ao conhecimento do negócio, a documentos internos e a informações específicas de domínio, sem depender apenas da memória pré-treinada do modelo. E isso vem desde 2023/2024.

Essa primeira onda foi importante. Ela tornou a GenAI corporativa muito mais ancorada e operacionalmente útil.

Mas um fato agora não é apenas que o RAG está crescendo. É que o RAG está evoluindo.

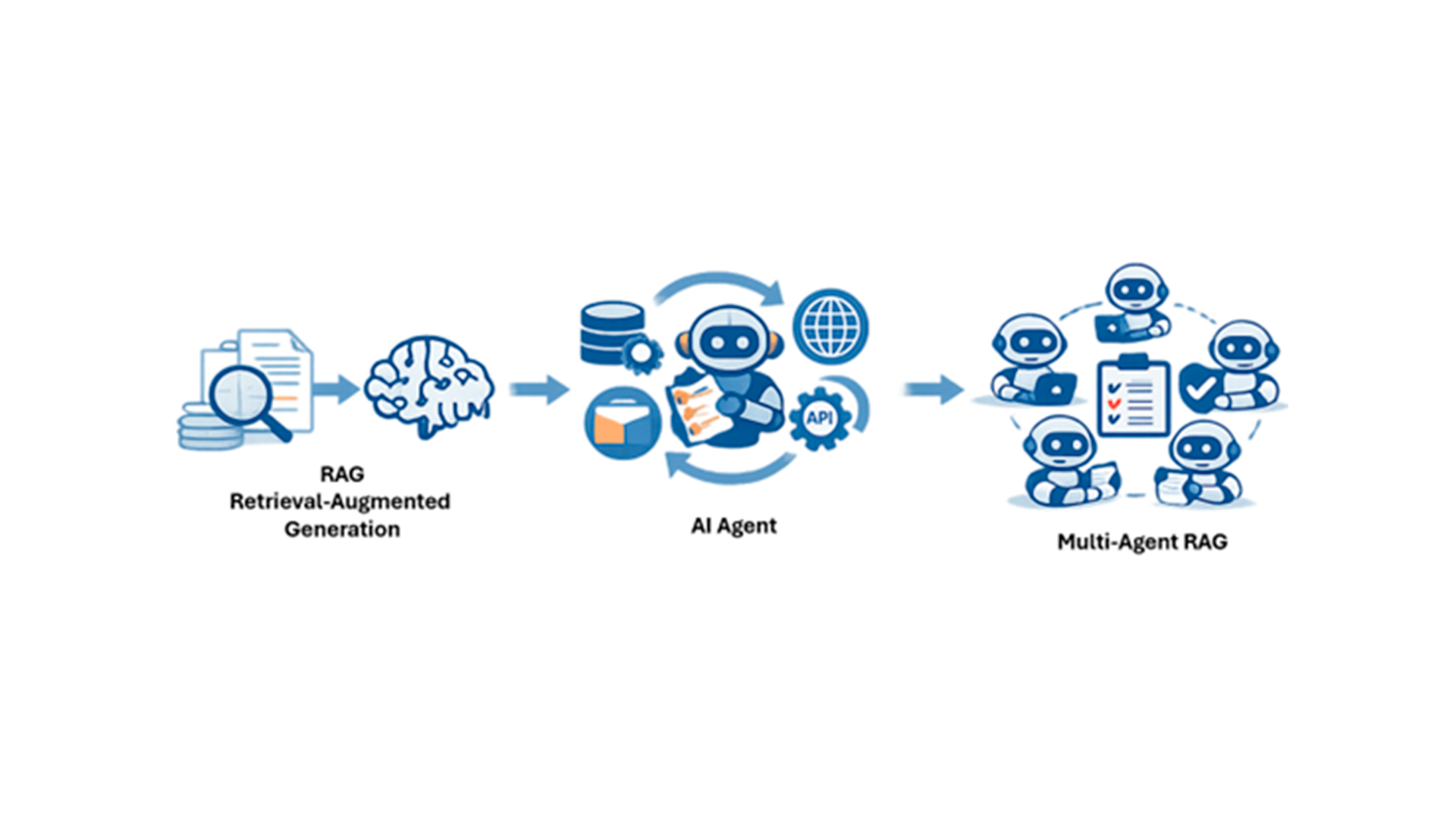

O que começou como um padrão de recuperação relativamente direto está se tornando algo muito mais dinâmico. Na prática, estamos saindo de uma recuperação estática para uma recuperação adaptativa e, a partir daí, para fluxos de recuperação coordenados por múltiplos agentes especializados.

E essa é uma mudança arquitetural significativa.

Ela ajuda a explicar por que as conversas sobre sistemas de GenAI estão cada vez menos centradas apenas em prompts e mais em pipelines, orquestração, validação e confiança.

Assim, este artigo trata exatamente disso: de como o RAG está evoluindo hoje.

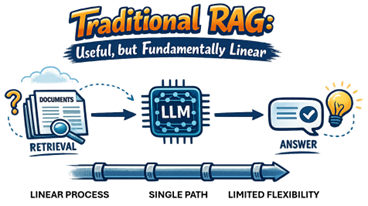

RAG Tradicional: útil, mas fundamentalmente linear

Então, vamos começar do começo. O RAG tradicional resolveu um problema importante. Em vez de pedir que um modelo de linguagem respondesse apenas com base em seu conhecimento geral, o sistema recupera conteúdo relevante de uma fonte externa, geralmente um banco vetorial, e usa esse contexto recuperado para fundamentar a resposta final.

Esse modelo funciona bem quando a pergunta do usuário é relativamente clara, a base de conhecimento está bem estruturada e a informação necessária já está presente de forma razoavelmente acessível. Nessas situações, o RAG tradicional pode ser eficiente e elegante. Uma consulta é submetida, comparada semanticamente com o conteúdo armazenado, e os trechos mais relevantes são enviados ao modelo de linguagem. O modelo então produz uma resposta com base nesse material contextual.

Para muitos casos de uso, isso já representava uma grande melhoria em relação ao prompting direto. Reduziu respostas sem suporte, aumentou a relevância e abriu caminho para o uso corporativo de LLMs em ambientes intensivos em conhecimento.

Ainda assim, o RAG tradicional carrega uma limitação importante: ele é, em grande parte, um processo de passagem única. Ele assume que a consulta inicial está bem formulada, que a primeira tentativa de recuperação é suficiente e que o material recuperado é bom o bastante para sustentar uma resposta confiável. Quando essas premissas se confirmam, o sistema funciona bem. Quando não, as fraquezas aparecem rapidamente.

E por fraquezas, podemos entender sistemas baseados em modelos GenAI que começam a falhar diante do usuário: perguntas ambíguas, tarefas com múltiplas etapas, informações fragmentadas, evidências conflitantes ou solicitações que dependem de dados em tempo real expõem o mesmo problema.

A recuperação nem sempre é um problema simples de busca. Em muitos casos do mundo real, trata-se de um processo exploratório e bem mais iterativo.

É exatamente aí que o RAG tradicional começa a mostrar seus limites.

Agentic RAG: a recuperação se torna adaptativa

Durante 2025, vimos o Agentic RAG surgir como uma resposta a essa limitação. Em vez de tratar a recuperação como uma ação única e estática, ele introduziu uma camada mais ativa de raciocínio entre a solicitação do usuário e a resposta final.

Nesse modelo, o sistema faz mais do que recuperar. Ele pode reinterpretar a consulta, refinar o caminho de busca, decidir se o resultado é suficiente e tentar novamente, se necessário. Em vez de assumir que o primeiro resultado já é bom o bastante, ele passa a tratar o caminho até a resposta como algo que pode ser avaliado e aprimorado ao longo do processo.

Isso muda a natureza do fluxo de trabalho. O sistema pode dividir uma solicitação complexa em partes menores, decidir se documentos internos são suficientes ou se também é necessária uma fonte externa, comparar achados parciais e determinar se mais recuperação é necessária antes de produzir uma resposta. A resposta final deixa de ser construída a partir de uma única etapa de recuperação e passa a surgir de uma sequência adaptativa de decisões.

Essa mudança é importante porque faz o sistema se comportar menos como um mecanismo de busca e mais como um processo guiado de raciocínio. Na prática, a recuperação se torna um componente ativo da resolução de problemas.

Isso é especialmente valioso em contextos corporativos, em que muitas tarefas não são simples buscas factuais. Elas podem envolver interpretação de políticas, múltiplos repositórios, sistemas internos, dados operacionais ou informações externas em constante mudança. Nesses contextos, o que importa não é apenas encontrar texto relevante, mas chegar a uma resposta suficientemente fundamentada, contextualizada e confiável.

O Agentic RAG responde a essa necessidade ao tornar o pipeline de recuperação iterativo. Ele adiciona julgamento ao fluxo. E, com isso, torna-se muito mais capaz de sustentar trabalho real.

Multi-Agentic RAG: a recuperação se torna inteligência coordenada

Ainda assim, existe um próximo passo natural. À medida que os fluxos corporativos se tornam mais complexos, um único agente lidando com todo o processo pode ficar sobrecarregado ou genérico demais. Diferentes etapas da tarefa frequentemente exigem diferentes tipos de especialização.

Entender a intenção do usuário é um tipo de problema. Buscar em bases internas de conhecimento é outro. Acessar APIs ou dados externos em tempo real é outro diferente. E ainda validar evidências, comparar fontes, verificar consistência e aplicar restrições de políticas adicionam mais camadas de responsabilidade. Quando tudo isso fica sob uma única lógica de orquestração, o sistema pode até funcionar, mas tende a se tornar mais difícil de escalar, governar ou refinar. Em muitos casos, esbarramos em desafios de contexto, memória, consumo excessivo de tokens, além do desafio de manutenção e escalabilidade.

É aqui que o Multi-Agentic RAG se torna particularmente atraente.

Em uma arquitetura Multi-Agentic RAG, o fluxo de trabalho é distribuído entre múltiplos agentes especializados, cada um com um papel mais explícito. Um agente pode se concentrar em interpretar e decompor a solicitação. Outro pode recuperar documentos corporativos. Outro pode consultar sistemas estruturados, bases operacionais ou APIs externas. Outro pode validar evidências, inspecionar inconsistências ou avaliar se a resposta atende a critérios de qualidade predefinidos. Um agente final pode sintetizar a saída sob guardrails específicos ou fronteiras de segurança, garantindo que a resposta seja coerente, fundamentada e alinhada às políticas da organização.

O que importa aqui não é simplesmente o número de agentes. O ganho real vem da especialização e da coordenação. Isso é um conceito importante!

Essa arquitetura permite que a recuperação evolua para algo mais próximo de um sistema colaborativo de inteligência. Diferentes agentes podem contribuir com capacidades distintas, checar resultados parciais entre si e reforçar a confiabilidade da resposta final. Em vez de depender de um único loop de recuperação ou de um único tomador de decisão genérico, a organização pode projetar um processo modular, com papéis mais claros, observabilidade mais forte e pontos de controle mais deliberados.

Portanto, para ambientes corporativos, isso é altamente relevante. Sustenta fluxos de trabalho mais sofisticados, ajuda em governança e confiança, e cria melhores condições para escalar.

Multi-Agentic RAG não é apenas um padrão de recuperação mais avançado. É uma arquitetura mais madura para sistemas de IA intensivos em conhecimento.

De fato, podemos esperar que, ao longo de 2026, várias empresas explorem cenários multi-agentes para diferentes casos de negócio. E isso deve criar uma demanda intensa por especialistas, desenvolvedores, arquitetos e projetos, à medida que mais aplicações passem a explorar desenhos agênticos.

E por que essa evolução importa?

Como resultado, a progressão do RAG tradicional para o Agentic RAG e, depois, para o Multi-Agentic RAG não será apenas um refinamento técnico. Ela já reflete uma mudança mais ampla na forma como as organizações estão pensando os sistemas de GenAI.

Num primeiro momento, o desafio era ancorar o modelo. Depois, o desafio passou a ser como tornar a recuperação adaptativa. Agora, o desafio é como orquestrar trabalho de conhecimento complexo entre múltiplas ferramentas, fontes, restrições e etapas de validação.

É por isso que essa evolução importa tanto. Ela sinaliza uma mudança de pipelines estáticos de pergunta e resposta para sistemas capazes de navegar ambiguidades, distribuir trabalho, avaliar evidências e responder com maior confiabilidade. Em outras palavras, a recuperação não é mais apenas sobre buscar contexto. Ela está se tornando parte da lógica do suporte à decisão empresarial. E aqui, o impacto será direto sobre aplicações, seja no universo SaaS, no SEO, para Tomada de Decisões ou Back-Office.

É também por isso que a conversa sobre design está mudando. A pergunta já não é apenas se um sistema usa RAG. Cada vez mais, a pergunta mais relevante é que tipo de arquitetura RAG está sendo usada, quão adaptativa ela é, como valida resultados e quão bem orquestra o caminho entre a pergunta e a resposta.

É aí que a diferenciação arquitetural passará a importar mais.

Conclusão

Não se engane: o RAG tradicional continua valioso. É simples, eficaz e ainda muito útil para muitos cenários de recuperação de conhecimento. Mas ele já não é suficiente, sozinho, para descrever a direção que a GenAI corporativa está tomando.

O Agentic RAG expande a recuperação para um processo adaptativo. Ele permite que o sistema raciocine sobre a própria busca, melhorando a forma como a informação é coletada e como as respostas são construídas.

O Multi-Agentic RAG leva isso um passo além ao distribuir o fluxo de trabalho entre agentes especializados. Ao fazer isso, transforma a recuperação em inteligência coordenada, com papéis mais claros, melhor modularidade e fundamentos mais fortes para confiança, controle e escala.

Visto por essa perspectiva, a evolução é clara. O RAG tradicional recupera contexto. O Agentic RAG gerencia o caminho até o contexto. O Multi-Agentic RAG coordena inteligência especializada ao longo de todo esse caminho.

E é por isso que o futuro do RAG não é apenas recuperação. É orquestração. Fica a dica!

Referências

Para apoiar esta discussão, recomendo as seguintes referências para informações adicionais e insights mais profundos:

- SHARMA, Chaitanya. Retrieval-augmented generation: A comprehensive survey of architectures, enhancements, and robustness frontiers. arXiv preprint arXiv:2506.00054, 2025.

- Ramachandran, Anand. (2025). Advancing Retrieval-Augmented Generation (RAG) Innovations, Challenges, and the Future of AI Reasoning. https://www.researchgate.net/publication/388722115_Advancing_Retrieval-Augmented_Generation_RAG_Innovations_Challenges_and_the_Future_of_AI_Reasoning

- GUPTA, Shailja; RANJAN, Rajesh; SINGH, Surya Narayan. A comprehensive survey of retrieval-augmented generation (rag): Evolution, current landscape and future directions. arXiv preprint arXiv:2410.12837, 2024.

- OCHE, Agada Joseph et al. A systematic review of key retrieval-augmented generation (rag) systems: Progress, gaps, and future directions. arXiv preprint arXiv:2507.18910, 2025.