A Sakana AI, empresa japonesa de inteligência artificial, lançou recentemente o Transformer². Essa nova abordagem promete transformar a forma como os modelos de linguagem aprendem e se adaptam a diversas tarefas. O Transformer² introduz métodos inovadores para superar os desafios de treinamento e adaptação enfrentados por redes neurais tradicionais.

Abordagem revolucionária no treinamento

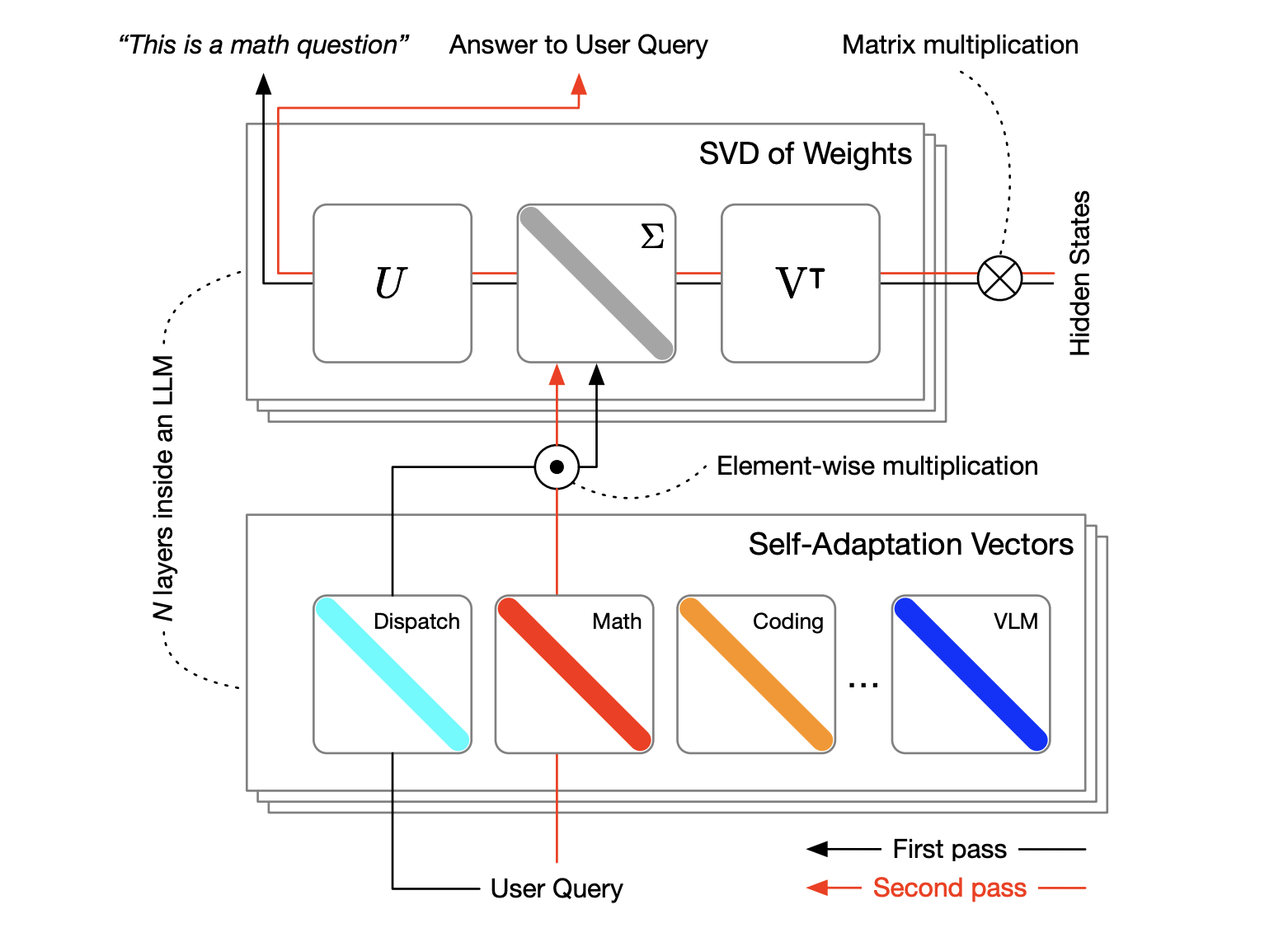

O Transformer² se diferencia dos sistemas tradicionais, que exigem a atualização de todos os pesos de uma rede neural ao aprender novas tarefas. Esses sistemas frequentemente sofrem de esquecimento catastrófico e demandam altos recursos computacionais. O novo modelo utiliza uma técnica chamada Singular Value Fine-Tuning (SVF), que foca em treinar vetores especialistas.

Esses vetores, em vez de alterar diretamente os pesos da rede, controlam a importância de cada conexão. Essa abordagem reduz o risco de esquecer conhecimentos anteriores e minimiza os custos associados ao re-treinamento de modelos.

Eficiência e economia de recursos

Uma das principais vantagens do Transformer² é sua capacidade de economizar recursos computacionais. Enquanto outros métodos, como o LoRA, necessitam de 6,82 milhões de parâmetros para adaptação, o SVF realiza a mesma tarefa com apenas 160 mil. Essa redução significativa permite maior eficiência em aplicações práticas, diminuindo a carga de processamento e o consumo de memória.

Ademais, os vetores especialistas do Transformer² podem ser combinados de forma eficaz, permitindo que o modelo se adapte rapidamente a uma variedade de tarefas sem perder a precisão em atividades anteriores. Essa flexibilidade posiciona o Transformer² como uma ferramenta única no cenário atual de IA.

Processo de aprendizado contínuo

O Transformer² também se destaca pelo uso de aprendizado por reforço para identificar os vetores especialistas ideais. Nesse processo, o modelo propõe soluções para diferentes tarefas e recebe feedback com base em seu desempenho. Ao ajustar continuamente seus vetores especialistas, o modelo melhora progressivamente até dominar cada tarefa.

Essa abordagem iterativa permite que o Transformer² mantenha um aprendizado constante, sem comprometer a qualidade dos resultados. O aprendizado contínuo também reduz significativamente o tempo necessário para adaptações futuras, garantindo maior agilidade em ambientes dinâmicos.

Impacto no futuro da inteligência artificial

Com o lançamento do Transformer², a Sakana AI estabelece um novo padrão para o treinamento de modelos de linguagem. Essa tecnologia não apenas resolve desafios críticos enfrentados por sistemas atuais, mas também abre caminho para aplicações mais acessíveis e sustentáveis no campo da IA.

Ao combinar eficiência, flexibilidade e aprendizado contínuo, o Transformer² reforça o compromisso da Sakana AI em liderar a inovação tecnológica e contribuir para avanços significativos no setor de inteligência artificial.

Fonte: The Decoder